“大而美法案”及其人工智能监管的“十年暂停”

作者 | 幸自奇 康诚秀

知识产权研究院

美国当地时间2025年5月22日,美国众议院(House)以215比214通过了被当选总统唐纳德·特朗普称为“大而美”的法案 – One Big Beautiful Bill Act(OBBBA),一部长度超过1000页的法案。特朗普总统要求参议院(Senate)在2025年7月4日美国国庆日前通过该法案。

全文共4090字

阅读时间约9分钟

1. “大而美法案”中人工智能条款

OBBBA第二部分(Part 2)名为“人工智能和信息技术现代化”(Artificial Intelligence and Information Technology Modernization),第43201节禁止各州和地方在法案生效后的10年内限制(limiting or restricting)或以其他方式监管进入州际贸易(interstate commerce)的人工智能模型、人工智能系统或自动化决策系统。除非州法律的主要目的和效果在于(1)消除法律障碍,促进AI模型、AI系统或自动化决策系统的部署或运营,或以促进这些系统采用的方式整合行政程序;(2)不属于对AI模型、AI系统或自动化决策系统在设计、性能、数据处理、文档、民事责任、税收、费用方面施加实质性要求;(3)仅增加合理且基于成本的费用和保证金;(4)若违反该法律或法规将受到刑事处罚。

Moratorium(暂停).— (1) IN GENERAL.—Except as provided in paragraph (2), no State or political subdivision thereof may enforce, during the 10-year period beginning on the date of the enactment of this Act, any law or regulation of that State or a political subdivision thereof limiting, restricting, or otherwise regulating artificial intelligence models, artificial intelligence systems, or automated decision systems entered into interstate commerce.

第43201节还规定向商务部拨款5亿美元资金,更换现有系统及部署商业人工智能和自动化技术实现联邦信息技术系统的现代化。商务部必须将拨款用于:(1)在商务部内,用最先进的商业人工智能系统和自动化决策系统替换或将遗留的商业系统现代化;(2)在商务部内,促进采用能够提高运营效率和服务交付的人工智能模型;(3)在商务部内,通过现代化的架构、自动化的威胁检测和集成的人工智能解决方案,提升联邦信息技术系统的网络安全。

第112204节对社会保障法案Social Security Act (42 U.S.C. 1395x et seq.)进行了修订,目的在于通过使用人工智能工具(Artificial Intelligence Tools),旨在减少和追回医保中的不当付款。卫生与公众服务部长应当在不迟于2029年1月1日前,并且此后每年不少于一次,向国会报告实施人工智能工具的情况以及追回不当付款的情况。如果卫生与公众服务部长未能在2029年与该最近一年之前的那一年相比将不当付款率降低50%,则需要说明原因。

类似的向美国联邦政府职能部门拨款专门用于人工智能系统建设的条款还包括向国防部拨款共计约5.5亿美元,用于改进测试资源管理中心的AI能力、扩大网络司令部的AI工作线、部署自动化和人工智能系统,以及向美国海关和边境保护局拨款10亿美元,用于采购新的非侵入性检查设备及AI、集成和机器学习系统等,以打击毒品犯罪。

2. 人工智能相关条款评述

人工智能10年免监管的“暂停”显示出美国联邦政府倾向于放松对人工智能监管的政策,这其中包括以牺牲州立法权、牺牲中小型AI企业利益、公众知情权以及知识产权保护为代价,全力发展人工智能生态。

大型AI公司将会越来越大

通过争夺在人工智能监管上的管辖权并阻止各州制定法律对AI进行监管,形成联邦级别的统一法典,OBBBA确保了大型AI公司在人工智能行业内的地位,例如Meta、OpenAI、Anthropic、微软、亚马逊和谷歌等公司,也将进一步拉开大公司与小型人工智能公司的差距。监督的缺失不会创造一个公平的竞争环境。相反,它巩固了那些已经处于顶端公司的优势。

例如,2024年9月28日通过的加利福尼亚州《通用人工智能:训练数据透明度》法案,要求开发者在其互联网网站上发布关于训练该系统或服务所使用的数据文档,包括数据集的来源或所有者、数据集如何促进人工智能系统或服务的预期目的、数据集是否包含受版权、商标或专利保护的数据,或数据集是否完全属于公共领域、数据集是否包含个人信息或聚合消费者信息、开发者是否对数据集进行了清理、处理或其他修改等信息。

加利福尼亚州作为Meta、Google等美国AI科技公司总部,自然不愿意对训练数据集进行充分披露。在州法律要求其披露训练数据,而联邦法律要求暂停对AI监管的情况下,很自然引发了一个讨论,对于人工智能监管的管辖权应当属于联邦还是各州。早在法案通过众议院投票之前,就有媒体报道指出该法案将是给Meta等科技巨头的礼物,Meta游说白宫反对州级监管,理由是它们“可能阻碍创新和投资”。

AI监管:决定权在联邦还是各州?

美国联邦和各州有不同的立法机构。在贸易问题上,联邦仅在州际贸易(interstate commerce)事项上享有管辖权。OBBBA十年暂停也仅能适用于进入州际贸易的人工智能系统。

传统的州内和州际管辖权分割显然在人工智能监管上没有任何意义。无论是训练数据的来源、消费者和企业用户,其来源均不可能局限于某一州内。想象一辆驾驶在州际公路的自动驾驶汽车,在驶离州际公路上后将适用一套完全不同的州法律监管。部分评论认为,由于AI系统的开发者也很难遵守50个州的法律,人工智能显然是州际贸易,而通过联邦层面的统一立法仿佛是唯一的选择。然而,在联邦立法持续缺位的情况下,各个州也在积极立法。

除加利福尼亚州,美国其他州也制定了与人工智能监管相关的立法,据全美州议会联合会统计,在2024年立法会议期间,包括北卡罗来纳州在内至少有45个州提出了与人工智能相关的法案(参见:https://www.ncsl.org/technology-and-communication/artificial-intelligence-2024-legislation)。

例如:

伊利诺伊州的《人工智能视频面试法案》(AIVIA),该法案对就业视频面试中人工智能的使用进行规范。要求雇主告知求职者将使用人工智能,解释其工作原理,并获得同意。如果求职者提出要求,雇主还必须在30天内销毁录像。

卡罗拉多州的《人工智能下的消费者保护法案》(Consumer Protections for Artificial Intelligence ),其关注在与人工智能系统互动中的消费者保护;要求高风险人工智能系统的开发者使用合理的谨慎来避免在高风险系统中的算法歧视。

特拉华州《人工智能委员会法案》(Artificial Intelligence Commission),该法案设立特拉华州人工智能委员会,规定该委员会负责就本州人工智能应用与安全问题向州议会及技术与信息部提出建议。同时规定该委员会需对州行政、立法和司法机构中所有生成式人工智能的使用情况进行清查,并识别生成式人工智能实施中的高风险领域。

反对的声音已经出现。美国佐治亚州共和党众议员呼吁参议院删除OBBBA中禁止各州监管人工智能(AI)的条款,认为该条款侵犯了各州的权利。该众议员表示,我坚决反对这一条款,这侵犯了州权,如果我知道法案中有这一条款,我就会投反对票。我们根本无法预知未来10年人工智能将具备何种能力,而放任其发展、束缚各州手脚的做法可能带来危险。

鉴于数州已经就人工智能的监管提出了或通过了相关法案,各州可向法院提起诉讼,挑战联邦政策或管辖权,这场关于司法管辖权的较量我们拭目以待。

公众对人工智能透明度的期待以及中欧经验

公众对AI技术带来的风险已有认知,我国国内已出现大量使用AI技术伪造声音和换脸后用于金融诈骗的案例。2025年1月,银川某建材公司经理张先生接到“领导”视频电话,因AI换脸技术高度逼真,他分两次转出20万元。2023年,内蒙古包头警方通报一起利用AI实施诈骗的案件,福州市某公司法人代表郭先生10分钟内被骗430万元。犯罪分子通过AI技术伪造某公司高管的面部及声音,与财务人员进行视频会议,诱导其向指定账户转账200万元。

尽管我国尚未出台与欧盟《人工智能法案》(Artificial Intelligence Act)类似的综合性人工智能法案,但在AI监管领域已制定了数个行业监管法律法规(Sectoral Approach),例如《互联网信息服务深度合成管理规定》强调不得利用深度合成服务从事法律、行政法规禁止的活动。第十七条要求深度合成服务提供者提供深度合成服务,可能导致公众混淆或者误认的,应当在生成或者编辑的信息内容的合理位置、区域进行显著标识,向公众提示深度合成情况,包括(一)智能对话、智能写作等模拟自然人进行文本的生成或者编辑服务;(二)合成人声、仿声等语音生成或者显著改变个人身份特征的编辑服务;(三)人脸生成、人脸替换、人脸操控、姿态操控等人物图像、视频生成或者显著改变个人身份特征的编辑服务;(四)沉浸式拟真场景等生成或者编辑服务。这些规定从应用场景层面对防范利用AI生成的虚假信息实施金融诈骗提供了框架性指引。

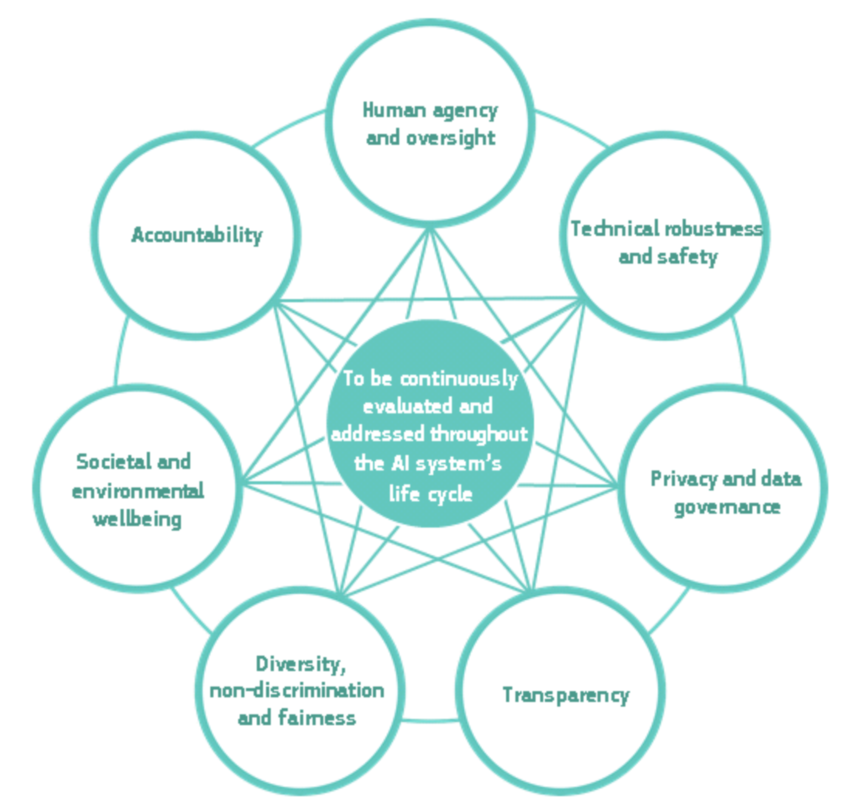

相比之下,欧盟《人工智能法案》则采取了风险等级(Risk-based approach)分级原则。欧盟《人工智能法》在序言中解释到,应当对人工智能系统采取一套符合比例原则及有效的强制力规则,采取一套明确界定的基于风险的措施。制定这套措施的基础源于2019年4月8日独立于欧盟委员会的人工智能高级别专家组(AI High-Level Expert Group)发布的《可信任人工智能的道德准则》(Ethics guidelines for trustworthy AI),其中提出了七项不具备约束力的道德准则,包括:(1)人类和监督;(2)技术稳健性和安全性;(3)隐私和数据治理;(4)透明度;(5)多样性、反歧视及公平;(6)社会、环境和福祉;(7)追责性。

(来源:《可信任人工智能的道德准则》第15页)

在上述标准的指引下,欧盟《人工智能法》根据人工智能系统最终可能实践(Practice)的领域和场景,如生物识别、情绪操控、教育培训等,将人工智能系统从高到低分成四个风险等级,其明确禁止的使用场景以及对应的例外如下表所示:

风险等级 | 分类基础及主要合规义务 |

禁止的人工智能系统 | 禁止,因为使用将对公民健康、安全和权利构成不可接受的风险 |

高风险的人工智能系统 | 允许,但须符合人工智能法案的要求(包括投放市场前的符合性评估,投放后的监管) |

有限风险的人工智能系统 | 允许,但在使用造成有限风险的情况下,须遵守特定的透明度和披露义务 |

最低风险的人工智能系统 | 允许,在使用风险最小的情况下,没有额外合规义务 |

如果认为欧盟“一刀切”的规定可能对AI发展产生桎梏(目前看来欧洲的确没能倒腾出任何能挑战中美的AI系统),那么在美国各州层面“就联邦制而言,我们希望各州能够尝试不同的制度”,可能是一种更合理的试验田制度。

在这样的大背景下,OBBBA“反向一刀切”的暂停,是否会因为引发公众和行业的过分担忧,出现规模性的对AI的抵制。又或者,在特朗普翻云覆雨、朝令夕改的政策变动下,大家已经习惯了180度大转弯,即使OBBBA能在参议院获得通过,在颁布后是否很快又被其他法案予以修正或实质性废止?

目前,这项“暂停”已经受到了两党的批评,这一点从文章开始的众议院投票结果也能看出。由于没有民主党人认可对AI监管的“Moratorium”(暂停),一些共和党参议员也表示保留意见,这项条款在这个“伟大而美丽的法案”下最终能否通过充满了不确定性。

不管最后结果如何,也不管OBBBA是否“大而美丽”,特朗普和马斯克持续的口水战及决裂,不仅将成为影响美国对内政策走向和对外战略布局的一个重要看点,还成为了上周末茶余饭后人们热议的最大谈资。

注释

上下滑动查看更多

[1]

Full text of OBBBA:

https://leginfo.legislature.ca.gov/faces/billNavClient.xhtml?bill_id=202320240AB2013

[2]

How every member of the US House voted on Trump’s agenda bill,

https://edition.cnn.com/2025/05/22/politics/house-voted-list-trumps-agenda-bill-dg

[3]

Trump’s ‘big, beautiful bill’ losing momentum in Senate,

https://thehill.com/homenews/senate/5333625-trump-big-beautiful-bill-senate-opposition/

[4]

《互联网信息服务深度合成管理规定》,国家互联网信息办公室 中华人民共和国工业和信息化部 中华人民共和国公安部令 第12号

[5]

Policy and investment recommendations for trustworthy Artificial Intelligence,

https://digital-strategy.ec.europa.eu/en/library/policy-and-investment-recommendations-trustworthy-artificial-intelligence

文章作者

YENLEX